[ad_1]

Liquid Web ha revelado el lanzamiento de su nueva GPU Alojamiento Un servicio diseñado para seguir el ritmo de las crecientes demandas de informática de alto rendimiento (HPC).

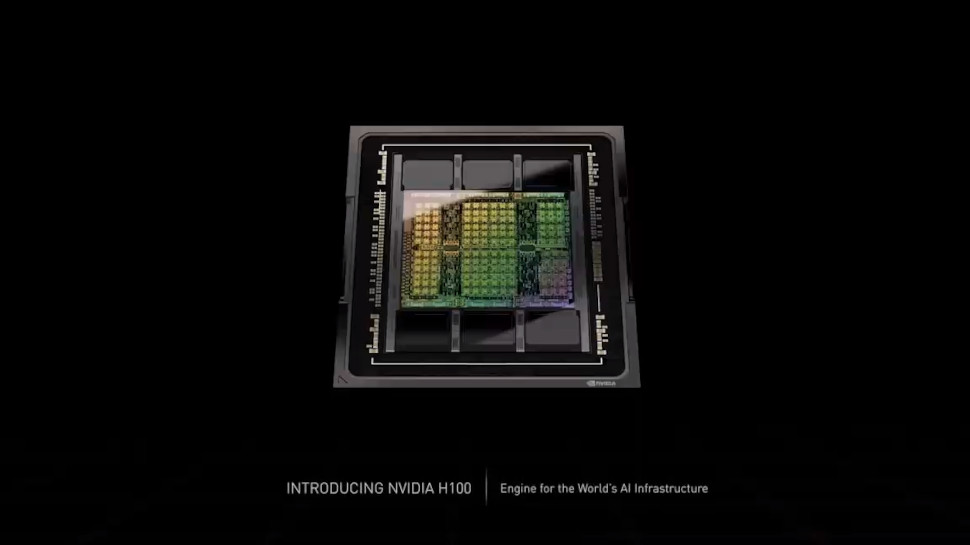

El nuevo espectáculo será divertido. NVIDIA La compañía confirmó que las unidades de procesamiento de gráficos están destinadas específicamente a desarrolladores que se centran en tareas de inteligencia artificial y aprendizaje automático.

Los usuarios que aprovechen el nuevo servicio pueden esperar una variedad de beneficios, según Liquid Web, incluido “rendimiento acelerado con GPU Nvidia”.

“Potencial sin explotar”

Sachin Puri, director de crecimiento de Liquid Web, dijo que el nuevo servicio apoyará a los desarrolladores a un “precio asequible” y proporcionará opciones de precios reservadas para los usuarios por horas.

“La IA tiene un potencial infinito sin explotar y queremos permitir que los desarrolladores e innovadores en IA aprovechen todo el poder de las GPU NVIDIA”, dijo Puri.

“Con estándares de rendimiento que hablan por sí solos, esta solución es la opción clara para acelerar las cargas de trabajo de IA y aumentar el valor. Y esto es solo el comienzo: permanezcan atentos a medida que ampliamos nuestra cartera para ofrecer soluciones aún más potentes en el futuro cercano”.

Ryan MacDonald, director de tecnología de Liquid Web, señaló que los servidores bajo demanda de la compañía pueden ofrecer un rendimiento de GPU “hasta un 15 por ciento” mejor que los entornos virtuales, o a un costo igual o menor.

“Nuestros servidores bajo demanda con tecnología NVIDIA y pilas de GPU preconfiguradas permiten a los clientes implementar cargas de trabajo de IA/aprendizaje y aprendizaje profundo rápidamente, maximizando el rendimiento y el valor centrándose en los resultados en lugar de en la preparación”. .

Lo que los usuarios pueden esperar del servicio de alojamiento de GPU de Liquid Web

El servicio utilizará una gama de GPU de alta gama, incluidas Nvidia L4, L40S y GPU H100. Estos proporcionan “velocidades de procesamiento excepcionales” que son ideales, dijo la compañía. Amnistía Internacional y aplicaciones de aprendizaje automático, Modelo de lenguaje grande (LLM) Desarrollo, aprendizaje profundo y análisis de datos.

Como parte del servicio, los usuarios también podrán acceder a opciones de metal bajo demanda, lo que permitirá a las empresas de Liquid Web tener “control total” de su infraestructura.

pasar de Red liquida Se produce en medio de un período de intenso enfoque empresarial en la inteligencia artificial, en el que las empresas están acelerando su desarrollo a nivel mundial.

El análisis de Grand View Research muestra que se espera que el mercado mundial de la IA alcance los 1,81 billones de dólares para 2030, lo que representa un aumento significativo con respecto a 2023, cuando el valor de mercado alcanzó los 196.630 millones de dólares.

Sin embargo, ha habido crecientes preocupaciones sobre los costos y la disponibilidad del hardware durante este período, ya que los precios de las GPU aumentaron drásticamente y los tiempos de espera para el hardware aumentaron.

Por eso, según Liquid Web, la flexibilidad es un aspecto clave del servicio. La compañía señaló que los usuarios pueden personalizar el alojamiento de GPU para satisfacer necesidades de rendimiento específicas según sea necesario, y apunta a empresas que van desde el nivel inicial hasta las empresas más grandes.

Más de TechRadar Pro

[ad_2]

Source Article Link