[ad_1]

mellizo Según se informa, Android AI obtendrá una nueva función que permitirá a los usuarios editar imágenes creadas por el chatbot. Un informe encontró evidencia de la función dentro de la aplicación beta de Google para Android. Curiosamente, se dice que la función permite a los usuarios editar imágenes utilizando mensajes de texto y resaltando una parte específica de la imagen. Si bien la función se encontró en la aplicación beta de Google, no se ha revelado y es posible que los probadores beta no puedan utilizarla.

Se dice que Gemini tendrá la posibilidad de editar fotos.

Editar imágenes generadas por un chatbot con inteligencia artificial (IA) es una propuesta difícil hoy en día. En la mayoría de los casos, los usuarios tienen la opción de recrear la imagen con indicaciones mejoradas. Sin embargo, no hay garantía de que las imágenes recién creadas sean las mismas que las imágenes generadas anteriormente por el chatbot. la semana pasada, Anunciar Capacidades de edición de imágenes de su chatbot.

![]()

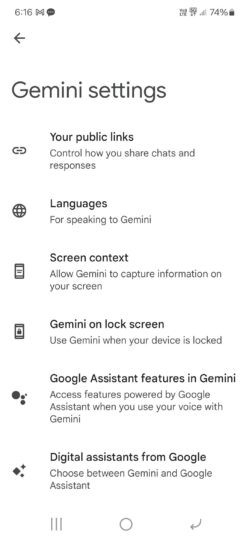

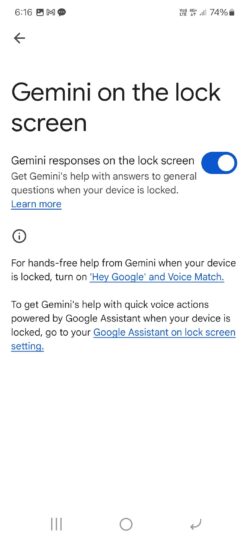

Función de edición de imágenes en Gemini

Crédito de la imagen: Autoridad de Android

Ahora, según un informe Según un informe de Android Authority, Google puede agregar una función similar a su chatbot. Las publicaciones han encontrado evidencia de la función dentro de la aplicación beta de Google para Androide Versión 15.29.34.29. Según se informa, los usuarios de Gemini AI en Android tendrán dos formas de editar la imagen generada.

Se dice que el primer método utiliza indicaciones de texto. Una vez creada una imagen, los usuarios pueden escribir mensajes para cambiar elementos específicos de la imagen. La publicación afirma que la IA ahora puede diferenciar entre cuándo los usuarios quieren una imagen completamente nueva y cuándo solo quieren que la imagen generada sea ligeramente diferente.

Se dice que el segundo método permite a los usuarios resaltar parte de una imagen delineándola en un círculo. Según la publicación, esto también se puede hacer usando un lápiz óptico en los teléfonos inteligentes que admiten este método. Una vez que seleccionan un segmento en un círculo, los usuarios pueden escribir un mensaje sobre lo que quieren cambiar en él y, según se informa, Gemini AI hará precisamente eso.

Vale la pena señalar que la función no está visible actualmente y se encontró al desmontar la aplicación. El informe especula Google Es posible que WhatsApp deba realizar algunos cambios en el lado del servidor antes de poder activarse. Sin embargo, el gigante tecnológico no ha hecho ningún anuncio sobre la función de edición de fotografías.

[ad_2]

Source Article Link