[ad_1]

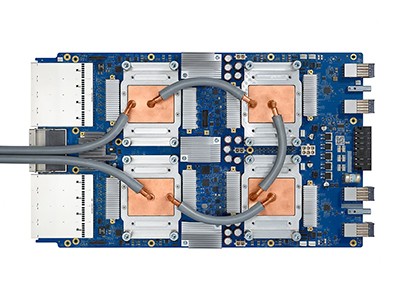

La GPU H100 del gigante tecnológico NVIDIA es un chip muy solicitado para la investigación de IA.Crédito: Nvidia

Muchos científicos universitarios se sienten frustrados por la limitada potencia informática de que disponen para la investigación. inteligencia artificial (AI), según una encuesta realizada a académicos de decenas de instituciones de todo el mundo.

Cómo los motores de búsqueda científicos impulsados por IA pueden acelerar su investigación

Resultados1que se publicó en el servidor de preimpresión arXiv el 30 de octubre, sugiere que los académicos carecen de acceso a sistemas informáticos más avanzados. Esto puede dificultar su capacidad de desarrollarse. Modelos de lenguajes grandes (LLM) Y realizar otras investigaciones sobre inteligencia artificial.

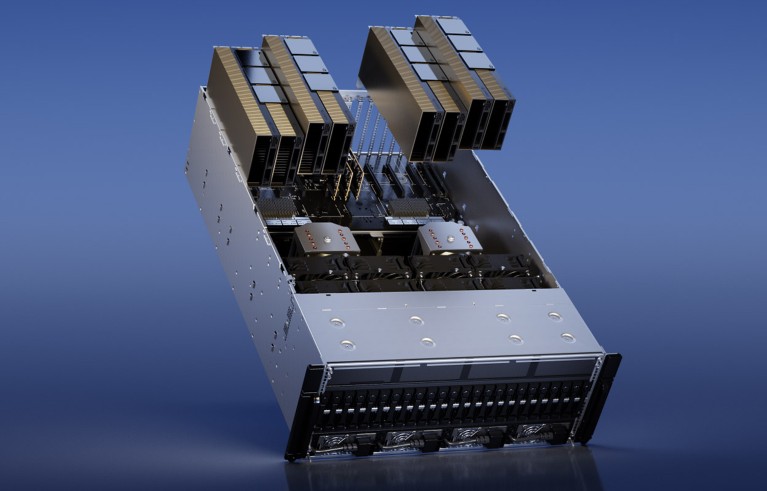

En particular, los investigadores académicos a veces no tienen los recursos para obtener suficiente poder. Unidades de procesamiento de gráficos (GPU): chips de computadora comúnmente utilizados para entrenar modelos de IA Lo que puede costar miles de dólares. Por el contrario, los investigadores de las grandes empresas tecnológicas tienen presupuestos más altos y pueden gastar más en GPU. “Cada GPU añade más potencia”, afirma el coautor del estudio Apoorv Khandelwal, científico informático de la Universidad de Brown en Providence, Rhode Island. “Si bien los gigantes de la industria pueden tener miles de GPU, es posible que los académicos solo tengan unas pocas”.

Cómo los chips informáticos de última generación están acelerando la revolución de la inteligencia artificial

“La brecha entre los modelos académicos e industriales es enorme, pero podría ser mucho menor”, dice Stella Biedermann, directora ejecutiva de EleutherAI, un instituto de investigación de IA sin fines de lucro en Washington, D.C. Ella dice que la investigación sobre esta disparidad es “extremadamente importante”.

Él espera tanto

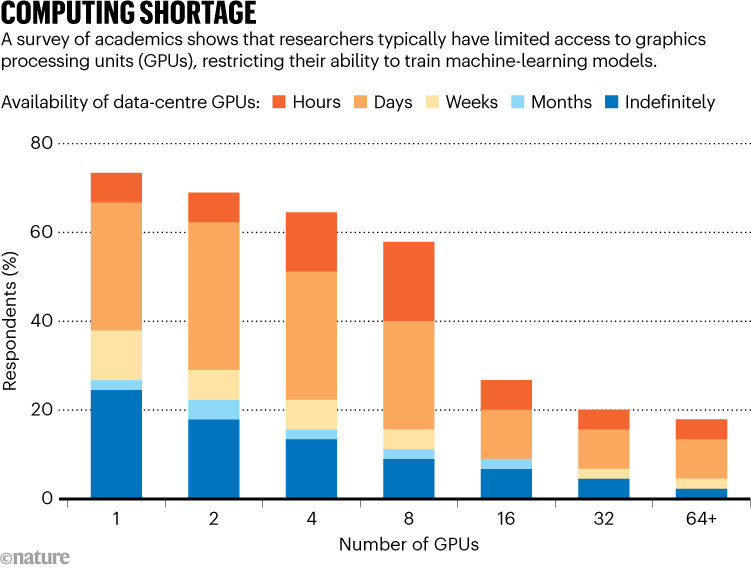

Para evaluar los recursos informáticos disponibles para los académicos, Khandelwal y sus colegas encuestaron a 50 científicos de 35 instituciones. De los participantes, el 66% calificó su satisfacción con sus capacidades informáticas en 3 o menos de 5. “No están nada satisfechos”, dice Khandelwal.

Las universidades tienen diferentes configuraciones para el acceso a la GPU. Algunos pueden tener un grupo informático central compartido entre departamentos y estudiantes, donde los investigadores pueden solicitar tiempo de GPU. Otras organizaciones pueden comprar máquinas para uso directo de los miembros del laboratorio.

Fuente: Referencia. 1

Algunos científicos dijeron que tuvieron que esperar días para obtener las GPU y señalaron que los tiempos de espera eran particularmente altos cuando se acercaban las fechas límite de los proyectos (consulte 'Escasez de informática'). Los hallazgos también resaltan las disparidades globales en accesibilidad. Por ejemplo, un participante mencionó las dificultades para encontrar GPU en Medio Oriente. Sólo el 10% de los encuestados dijo tener acceso a él GPU NVIDIA H100Potentes conjuntos de chips diseñados para la investigación de IA.

Esta barrera hace que la capacitación previa (es decir, proporcionar grandes conjuntos de datos a los estudiantes de MBA) sea particularmente difícil. “Es tan caro que la mayoría de los académicos ni siquiera piensan en hacer ciencia con una formación previa”, afirma Khandelwal. Él y sus colegas creen que los académicos ofrecen una perspectiva única en la investigación de la IA y que la falta de acceso a la potencia informática puede limitar este campo.

Energía nuclear de IA: lo que se necesitará para reabrir de forma segura Three Mile Island

“Es realmente importante contar con un entorno de investigación académica saludable y competitivo para el crecimiento y el desarrollo tecnológico a largo plazo”, dice el coautor Eli Pavlik, que estudia informática y lingüística en la Universidad de Brown. “Cuando hay investigación industrial, hay presiones comerciales obvias, y eso a veces motiva una explotación más rápida y menos exploración”.

Métodos efectivos

Los investigadores también investigaron cómo los académicos pueden hacer un mejor uso de los recursos informáticos menos potentes. Calcularon el tiempo que llevaría entrenar previamente a varios LLM utilizando hardware de bajos recursos, con entre 1 y 8 GPU. A pesar de estos recursos limitados, los investigadores pudieron entrenar con éxito muchos modelos, aunque llevó más tiempo y requirió que adoptaran métodos más eficientes.

Los modelos de IA alimentados con datos generados por IA rápidamente difunden tonterías

“De hecho, podemos usar las GPU que tenemos durante un período de tiempo más largo, de modo que podemos compensar algunas de las diferencias entre lo que tiene la industria”, dice Khandelwal.

“Es genial ver que realmente se puede entrenar un modelo más grande de lo que mucha gente había supuesto con recursos computacionales limitados”, dice Ji-Ong Lee, que estudia modelos neuronales explícitos en la Universidad de Saarland en Saarbrücken, Alemania. Añade que el trabajo futuro podría centrarse en las experiencias de investigadores de la industria en pequeñas empresas, que también luchan por el acceso a los recursos informáticos. “No es que todos los que tienen acceso a la informática ilimitada la tengan”, afirma.

[ad_2]

Source Article Link