[ad_1]

Cuando interactúas con chat gbt Y otras herramientas de IA generativa conversacional procesan su información a través de algoritmos para crear una respuesta que puede parecer que proviene de otro ser consciente a pesar de la realidad de cómo funcionan los modelos de lenguaje grandes (LLM). Dos tercios de los encuestados estudiar Sin embargo, los investigadores de la Universidad de Waterloo creen que los chatbots de IA son de alguna manera conscientes y pasan la prueba de Turing para convencerlos de que la IA es equivalente a los humanos en conciencia.

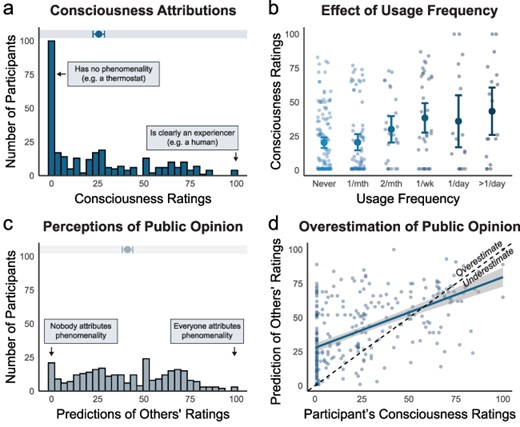

La inteligencia artificial generativa, tal como se materializa en Abierto AIEl trabajo de OpenAI en ChatGPT ha logrado avances significativos en los últimos años. La empresa y sus competidores hablan a menudo de una visión de inteligencia artificial general (AGI) con inteligencia similar a la humana. Incluso OpenAI tiene Nueva escala Medir qué tan cerca están sus modelos de lograr inteligencia artificial general. Pero ni siquiera los expertos más optimistas sugieren que los sistemas AGI sean conscientes de sí mismos o capaces de mostrar emociones verdaderas. Sin embargo, de las 300 personas que participaron en el estudio, el 67% dijo que creía que ChatGPT podía sentir, intuir y percibir su existencia de alguna manera.

También hubo una correlación notable entre la frecuencia con la que alguien usaba herramientas de inteligencia artificial y la probabilidad de que percibiera conciencia dentro de ellas. Esta es una prueba de lo bueno que es ChatGPT imitando a los humanos, pero eso no significa que la inteligencia artificial haya despertado. El enfoque conversacional de ChatGPT probablemente hará que estas herramientas parezcan más humanas, aunque ningún modelo de IA funcionará como un cerebro humano. Mientras OpenAI trabaja en un modelo de IA capaz de realizar investigaciones de forma independiente, se llama fresaEsto sigue siendo diferente de la inteligencia artificial que es consciente de lo que hace y por qué.

“Si bien la mayoría de los expertos niegan que la IA actual pueda ser consciente, nuestra investigación muestra que para la mayor parte del público en general, la conciencia de la IA ya es una realidad”, explicó la Dra. Clara Colombato, profesora de psicología en la Universidad de Waterloo y codirectora de El estudio. “Estos hallazgos demuestran el poder del lenguaje porque la conversación por sí sola puede llevarnos a creer que un agente que se ve y funciona de manera muy diferente a nosotros podría tener una mente”.

Mal servicio al cliente

La creencia en la conciencia de la IA podría tener implicaciones importantes en la forma en que las personas interactúan con las herramientas de IA. En el lado positivo, esto fomenta el buen comportamiento y hace que sea más fácil confiar en lo que hacen las herramientas, lo que puede facilitar su integración en la vida cotidiana. Pero la confianza conlleva riesgos, desde una dependencia excesiva de la IA hasta una dependencia emocional de la IA y la falta de interacciones humanas.

Los investigadores planean profundizar en los factores específicos que hacen que la gente crea que la IA tiene conciencia y lo que eso significa a nivel individual y social. Esto también incluirá análisis a más largo plazo de cómo estas actitudes cambian con el tiempo y en relación con el trasfondo cultural. Comprender las percepciones públicas sobre la concienciación sobre la IA es crucial no sólo para el desarrollo de productos de IA sino también para las normas y regulaciones que rigen su uso.

“Además de las emociones, la conciencia está vinculada a las capacidades intelectuales que son esenciales para la responsabilidad moral: la capacidad de formular planes, actuar intencionalmente y controlarse son principios de nuestros sistemas morales y legales”, dijo Colombato. “Por lo tanto, estas posiciones públicas deberían ser una consideración clave en el diseño y regulación de la IA para un uso seguro, junto con el consenso de expertos”.

También te puede interesar

[ad_2]

Source Article Link