[ad_1]

TechRadar está probado y testado Mejor VPN El servicio no sólo es excelente para mejorar su privacidad en línea, sino que también es una de las mejores soluciones para combatir las estafas en tiendas falsas en línea.

Los auditores independientes reciben la calificación AV-Comparatives NordVPNEl rastreador de malware y bloqueador de anuncios de Google está clasificado como la tercera mejor herramienta para combatir el fraude en las compras en línea entre 35 programas similares.

El proveedor ha lanzado la versión mejorada de su bloqueador de seguimiento, Protección contra amenazas profesionalesEl pasado mes de junio, NordVPN lanzó un nuevo servicio VPN para proteger mejor a los usuarios contra ciberataques cada vez más sofisticados. En ese momento, AV-comparatives certificó a NordVPN como herramienta antiphishing, convirtiéndose en la primera empresa de VPN en recibir tal premio.

Cómo te protege NordVPN de tiendas online falsas

“Los sitios de compras falsos son un problema creciente para los compradores de todo el mundo”, afirmó Dominincas Verbikas, jefe de desarrollo de Threat Protection. “Parecen plataformas de comercio electrónico reales y a menudo utilizan diseños profesionales, reseñas de clientes falsas y descuentos atractivos para engañar a los compradores. Estamos haciendo todo lo posible para proteger a nuestros clientes de las graves consecuencias causadas por estos sitios”.

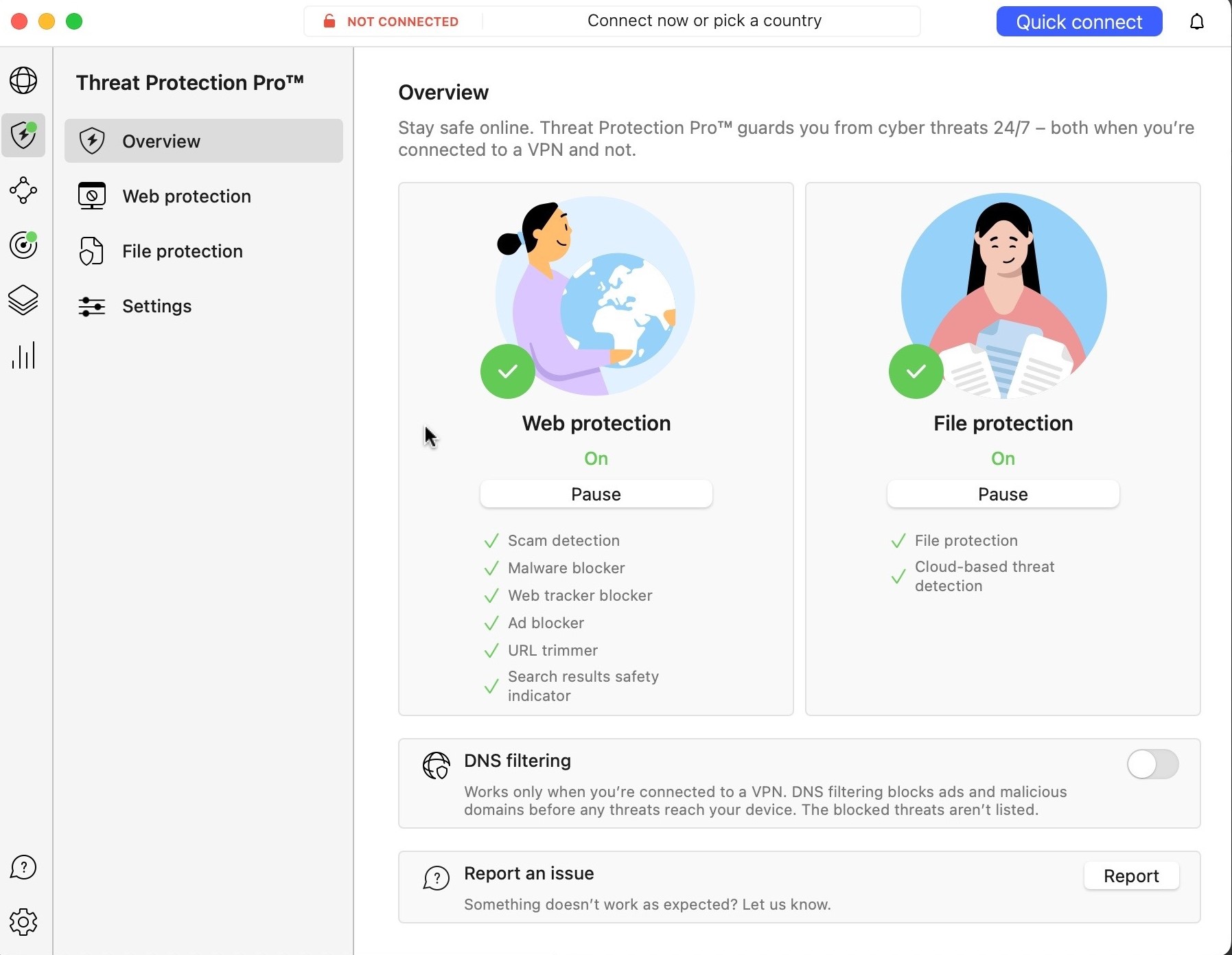

Disponible solo en Windows y macOS en el momento de escribir este artículo, Threat Protection Pro es una versión mejorada del antiguo rastreador, malware y bloqueador de anuncios integrado en red privada virtual programación.

Mientras que lo que ahora se conoce como Threat Protection Lite bloquea sitios web maliciosos, rastreadores y anuncios a nivel de DNS, y solo está activo cuando está conectado a una VPN, Threat Protection Pro hace todo lo posible para combatir ataques más sofisticados como tiendas online falsas. Phishingy otras formas Anuncios maliciososEste último funciona a nivel de red, escaneando todo el tráfico directamente en el dispositivo cliente sin necesidad de una conexión VPN activa.

“Esto es exactamente por lo que se esfuerzan los líderes del mercado Antivirus “Lo hacen”, dijo el teniente coronel.

La nueva herramienta de NordVPN ha demostrado cumplir las promesas del proveedor contra las estafas de compras en línea. durante Prueba de comparaciones AVPude detectar casi el 70% de las tiendas falsas. Las extensiones de navegador personalizadas fueron las dos únicas herramientas que pudieron superarlo.

Vale la pena señalar que, a diferencia de Threat Protection Lite, que está incluido en todos los planes, Threat Protection Pro es exclusivo solo para suscriptores Plus y Ultimate.

Aunque NordVPN puede protegerlo eficazmente de la mayoría de las estafas en línea, vale la pena aprender a detectar señales de alerta cuando compra algo en línea en un sitio que no conoce.

La compañía VPN ofrece algunos consejos para ayudarle a mantenerse alerta mientras compra en línea:

- Sea escéptico acerca de los increíbles descuentos. Como regla general, si suena demasiado bueno para ser verdad, probablemente lo sea la mayor parte del tiempo. El equipo de Nord recomienda comparar precios en sitios confiables y tener cuidado con los grandes descuentos en artículos populares.

- Verifique la calidad del sitio. Aunque algunos ciberatacantes se han vuelto expertos en esta área, muchas estafas siguen siendo fáciles de detectar. Debes buscar mala gramática, imágenes de baja calidad o enlaces rotos.

- Mira los dominios. Los sitios falsos generalmente vienen con nombres de dominio mal escritos, así que asegúrese de verificarlo antes de hacer clic en ellos. Nord también sugiere verificar si hay un certificado SSL válido, que viene en el formato “https://”, y un ícono de candado para asegurarse de que la conexión sea confiable. Para mayor seguridad, utilice una herramienta de inspección de URL para comprobar si un dominio es seguro: NordVPN la tiene uno es gratis.

- La investigación de antecedentes es clave. ¿Todo parece legítimo y estás listo para comprar? Antes de hacer clic en el botón, debe realizar una investigación adicional. Verifique la reputación de los minoristas en línea para ver qué dicen otros usuarios sobre ellos. Eche un vistazo a las políticas de privacidad, los términos y condiciones y la información de contacto del sitio para ver si algo no cumple.

- Tenga cuidado con los métodos de pago inusuales. Por razones obvias, los estafadores generalmente prefieren pagos difíciles de rastrear, como criptomonedas, tarjetas de regalo o transferencias bancarias. Ofrecer estos métodos no es necesariamente una señal de fraude, pero debe tener cuidado si un comerciante insiste en utilizar uno de estos métodos.

[ad_2]

Source Article Link