[ad_1]

Las redes sociales son un canal importante para la comunicación y el debate político en la India.Crédito: Dheeraj Singh/Bloomberg/Getty

La capacidad de la inteligencia artificial generativa (genAI) para crear texto, imágenes, audio y vídeo que parezcan auténticos es motivo de creciente preocupación en todo el mundo. Ahora que muchos países se dirigen a las urnas este año, la posibilidad de que ese contenido alimente la desinformación y manipule las narrativas políticas representa una preocupante adición a la lista de desafíos que enfrentan las autoridades electorales.

Durante los últimos 12 meses, han surgido varios ejemplos destacados de deepfakes producidos por genAI. Estas incluyen imágenes del candidato presidencial republicano de EE.UU. Donald Trump con un grupo de seguidores afroamericanosgrabación de audio de un político eslovaco Alegando fraude en las próximas elecciones Y fotografiado por Explosión frente al edificio del Pentágono del Departamento de Defensa de EE.UU..

Pero a pesar de la enorme atención que están recibiendo estos deepfakes, los estudios sistemáticos sobre el impacto de la IA genética en la desinformación son limitados. Esto se debe principalmente a que el acceso a datos completos está restringido debido a preocupaciones de privacidad y restricciones impuestas por las plataformas de redes sociales. Muchas preguntas cruciales siguen sin respuesta.

Lo que sabemos y lo que no sabemos sobre cómo se difunde la información errónea en línea

Por ejemplo, no está claro qué tan extendidas están las “noticias falsas” generadas por IA: hay pocos datos concretos disponibles sobre la frecuencia con la que se utilizan técnicas de IA para crear contenido engañoso. Los investigadores tampoco comprenden aún hasta qué punto la información falsa generada por inteligencia artificial se comparte en las redes sociales, ni su impacto en la opinión pública. Estas incertidumbres resaltan los desafíos de abordar la desinformación impulsada por la IA y resaltan la necesidad de una investigación y un seguimiento más sólidos para comprender todos los impactos de estas tecnologías.

Llevamos más de cinco años trabajando en India para comprender cómo los partidos políticos utilizan la plataforma de mensajería WhatsApp para difundir información errónea.1,2. Durante el año pasado, recopilamos datos de usuarios de aplicaciones en la India rural a través de un método de donación de datos que preserva la privacidad.3.

WhatsApp es un canal importante para la comunicación y el debate político en la India4Como es el caso de países como Brasil y Kenia. Nuestra investigación incluye muchos nuevos usuarios de Internet que constituyen una gran proporción de los usuarios rurales de Internet en la India. Es probable que estos usuarios estén menos familiarizados con las capacidades de la IA genética y quizás sean más susceptibles a su influencia que los usuarios experimentados. Aquí compartimos algunos hallazgos de nuestra investigación en curso.

¿Qué tan popular es el contenido genAI?

Elegimos centrar nuestro estudio en Uttar Pradesh, el estado más grande de la India, con una población de más de 220 millones. Contactamos a aproximadamente 500 usuarios, seleccionados para proporcionar una muestra representativa de variables demográficas como edad, religión y secta. Aunque pueda parecer un grupo pequeño de usuarios, esta es una de las muestras más grandes obtenidas al pedir a los usuarios de WhatsApp que donen datos de sus teléfonos con fines de investigación. También observamos patrones de mensajes durante un período lo suficientemente largo como para dar una idea confiable de cómo van las conversaciones políticas. Hicimos esto monitoreando todos los grupos no personales de WhatsApp y descargando automáticamente cualquier mensaje nuevo. Hicimos todo lo posible para eliminar cualquier identificador personal antes de almacenar y analizar datos, y para garantizar que el proceso de consentimiento fuera completo e informativo.3.

El primer conjunto de cartas se recogió entre agosto y octubre del año pasado, justo antes de las principales elecciones regionales. Esto proporcionó un conjunto de datos de casi dos millones de mensajes de grupos privados de WhatsApp, lo que nos dio, por primera vez, una idea de lo que los usuarios comunes de WhatsApp estaban viendo y discutiendo. Los temas variaron ampliamente e incluyeron religión, educación, vida rural y otros asuntos nacionales y locales.

Una mujer vota en las elecciones generales indias de 2024.Fotografía: Himanshu Sharma/AFP/Getty

Estábamos particularmente interesados en que el contenido se volviera viral en WhatsApp, que la aplicación marcaba como “reenviado varias veces”. Esta marca se coloca en el contenido que se reenvía a través de una cadena que incluye al menos cinco saltos desde el remitente original. Cinco saltos pueden significar que el mensaje ya se ha distribuido a una gran cantidad de usuarios, aunque WhatsApp no revela el número exacto.

Todavía no existen métodos automatizados para identificar contenido generado por IA a escala, por lo que examinamos manualmente los 1.858 mensajes virales de nuestra muestra. Para anotar imágenes y vídeos de IA genética, inicialmente nos centramos en contenido que mostraba signos claros de haber sido generado por máquina, como algunas anomalías en la composición o mezclas no naturales. También contratamos a especialistas que pueden evaluar la autenticidad de cada contenido centrándose en características que se sabe que son típicas de las creaciones de IA. Reconocemos las limitaciones inevitables en tales evaluaciones hasta que surjan mejores técnicas para caracterizar los materiales generados por genAI.

La desinformación representa una amenaza para la democracia mayor de lo que se podría pensar

De los 1.858 mensajes virales, menos de 24 contenían copias de contenido generado por genAI, una huella de solo el 1%. Aunque este número puede estar un poco por debajo del conteo y no incluye mensajes de texto o de voz, el resultado indica que la prevalencia de contenido generado por genes de IA en mensajes virales en la India es relativamente baja. Esto parece haber seguido igual durante las elecciones generales “de múltiples etapas” que acaban de concluir en el país. Seguimos monitoreando el contenido viral y no hemos detectado ningún aumento significativo en el contenido de genAI utilizado en campañas políticas. Es posible que el impacto de la genAI en la desinformación en las elecciones no sea tan generalizado como se temía.

Sin embargo, estos son los primeros días de la tecnología, y nuestros primeros hallazgos demuestran la capacidad de genAI para crear imágenes y narrativas convincentes y culturalmente resonantes, que se extienden mucho más allá de lo que los creadores de contenido tradicionales podrían lograr.

¿Qué muestra el contenido genAI?

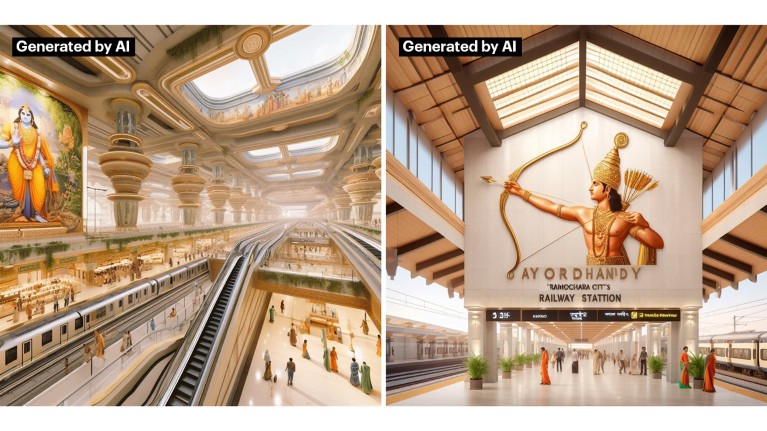

Una de las categorías de contenido engañoso que identificamos se relaciona con proyectos de infraestructura. Imágenes visualmente plausibles de IA de una estación de tren futurista, que supuestamente representa una nueva instalación en Ayodhya, una ciudad que muchos hindúes creen que es el lugar de nacimiento del dios Lord Ram, han logrado volverse virales. Las imágenes mostraban una estación limpia con fotografías de Lord Ram en sus paredes. Ayodhya ha sido escenario de tensiones religiosas, especialmente desde que los nacionalistas hindúes demolieron una mezquita en diciembre de 1992 para poder construir un templo sobre sus ruinas.

El rápido desarrollo de la infraestructura, incluida la modernización de las estaciones de tren, es un objetivo político importante del Partido Bharatiya Janata, que busca presentar a la India como una economía en rápida modernización ante el público nacional e internacional. Sin embargo, nuestros datos no proporcionan evidencia directa que vincule al BJP, o cualquier otro partido político, con la creación o difusión de imágenes generadas por IA.

Las imágenes generadas por IA difundidas en las redes sociales incluyen una maqueta de la moderna estación de tren de Ayodhya.Crédito: k. garimilla, Preimpresión en GitHub

Otro tema evidente en el contenido de genAI parecen ser las proyecciones de un tipo de superioridad hindú. Por ejemplo, descubrimos vídeos generados por IA que mostraban a santos hindúes musculosos haciendo comentarios ofensivos contra los musulmanes, a menudo haciendo referencia a injusticias históricas. La inteligencia artificial también se ha utilizado para crear imágenes que glorifican a dioses hindúes y a hombres con cuerpos exagerados que lucen símbolos hindúes, una continuación de una táctica propagandística bien documentada y de larga data para promover el dominio hindú en la India. También encontramos medios que representan escenas inventadas de la guerra en curso en Gaza, equiparando sutilmente los ataques del 7 de octubre de 2023 por parte de Hamás contra Israel con la presunta violencia cometida por musulmanes contra hindúes en la India. Utilizar los acontecimientos actuales para atacar a las minorías es una tendencia bien documentada en el contexto sociopolítico indio.5.

¿Qué hay que completar?

Aunque nuestro estudio sugiere que es poco probable que la tecnología genética de IA dé forma a las elecciones por sí sola en este momento, los casos que documentamos demuestran su potencial para personalizar y catalizar campañas de desinformación en el futuro. Incluso si este contenido se parece a un anime, aún así puede ser muy efectivo, porque sus imágenes demasiado idealizadas resuenan a nivel emocional, especialmente entre los espectadores que ya tienen creencias empáticas. Este compromiso emocional, combinado con la autenticidad visual proporcionada por la IA moderna6 – Desdibujar la línea entre animación y realidad puede permitir que dicho contenido sea atractivo, aunque esto requiere más estudio.

Es importante señalar que la información errónea se puede crear fácilmente mediante medios de baja tecnología, como atribuir incorrectamente una fotografía antigua fuera de contexto a un evento actual o mediante el uso de software de edición de fotografías disponible en el mercado. Por lo tanto, es posible que la genAI no cambie mucho la naturaleza de la información errónea.

Investigadores de desinformación: un papel clave para los científicos en las próximas elecciones

Sin embargo, a medida que la tecnología madure y se vuelva más accesible, aumentará la necesidad de vigilancia y contramedidas. GenAI se puede utilizar para crear una gran cantidad de imágenes de forma rápida y económica, y brinda la capacidad de personalizar dinámicamente el contenido para adaptarlo a grupos culturales o sociales específicos. Su uso también puede ocultar el origen del contenido, lo que dificulta rastrear a sus creadores. Esta combinación de escalabilidad, rentabilidad, personalización y anonimato podría mejorar la influencia de genAI en la opinión pública.

A medida que esta tecnología disruptiva siga evolucionando, será fundamental realizar un seguimiento continuo de su propagación e impacto en diferentes contextos. En el contexto indio y en otros lugares, los investigadores deben profundizar en tres aspectos clave relacionados con el impacto de la IA en la sociedad y la política.

¿Puede la genAI nivelar el campo de juego? La GenAI tiene el potencial de alterar la dinámica de poder actual en la producción de contenidos. Al democratizar la creación de contenidos, desafía el dominio de los partidos políticos con buenos recursos.

¿Pueden las empresas de redes sociales hacer más? La naturaleza descentralizada de WhatsApp presenta tanto oportunidades como desafíos para la distribución de contenido. Aunque permite una amplia difusión de información, también complica los esfuerzos para regular y moderar el contenido. La capacidad de GenAI para crear contenido personalizado y dirigido a escala puede amplificar los sesgos y las cámaras de eco existentes. Sin mecanismos de moderación eficaces, las plataformas corren el riesgo de convertirse en un caldo de cultivo para la desinformación y la propaganda.

¿Cómo influye la genAI en las creencias? Aunque hoy en día los usuarios pueden detectar contenido generado por genAI, puede resultar cada vez más difícil distinguir entre lo real y lo falso a medida que la tecnología mejora. Esto es particularmente preocupante en el contexto de aplicaciones de mensajería como WhatsApp, porque es más probable que los usuarios crean en el contenido que reciben de grupos o individuos de confianza, incluso si es engañoso o falso.7.

Por lo tanto, los formuladores de políticas deben desarrollar estrategias globales y locales integrales para combatir los efectos nocivos del contenido generado por IA. Los mensajes públicos para enfatizar la importancia de la verificación de la fuente son clave. Crear un marco para marcar el contenido como generado por IA es una necesidad urgente. También es importante lanzar campañas de concientización pública para educar a las comunidades, especialmente a los usuarios de tecnología sin experiencia, sobre los matices del contenido generado por IA.

Los nuevos marcos regulatorios desarrollados en colaboración, en los que participan los gobiernos, la industria tecnológica y el mundo académico, pueden garantizar que las normas sigan el ritmo de los avances en IA. La última pieza del rompecabezas es mantener el apoyo a la investigación para crear tecnologías de vanguardia que puedan detectar la IA a escala, un requisito crítico en la era de los medios sintéticos.

Se debe tener mucho cuidado al diseñar mecanismos de mitigación, porque comprometer la privacidad y la seguridad digital para atacar la información errónea impulsada por la IA podría ser contraproducente. Advertimos firmemente contra propuestas que podrían socavar el cifrado de extremo a extremo en plataformas como WhatsApp.

[ad_2]

Source Article Link