[ad_1]

el Conferencia Google I/O 2024 El discurso de apertura fue un Festival Gemini repleto, y el director ejecutivo Sundar Pichai tuvo razón al describirlo como su versión de The Eras Tour, específicamente, la “Era Gemini”, en la cima.

Todo el discurso de apertura fue sobre Géminis y la IA. En realidad, Google Lo dijo las últimas 121 veces. Desde la presentación de un asistente futurista de IA llamado “Proyecto Astra” que puede ejecutarse en un teléfono (y quizás algún día en gafas) hasta la integración de Gemini en casi todos los servicios o productos que ofrece la empresa, la IA definitivamente ha sido el gran tema.

Todo eso fue suficiente para derretir las mentes de todos, excepto de los entusiastas más fervientes del LLM, por lo que desglosamos las 7 cosas más importantes que Google reveló y discutió durante su discurso de apertura de I/O 2024.

1. Google abandonó el proyecto Astra, un “agente de inteligencia artificial” para la vida cotidiana

Entonces resulta que Google tiene una respuesta a esta pregunta. OpenAI GPT-4o Y microsoftCopiloto. Proyecto Astraconocido como el “agente de IA” de la vida cotidiana, es básicamente lente de google Con esteroides y se ve muy impresionante, capaz de comprender, razonar y responder a videos y audio en vivo.

En un video grabado en un teléfono Pixel, se ve al usuario caminando por una oficina, proporcionando una transmisión en vivo a la cámara trasera y haciendo preguntas al Astra. Géminis observaba y comprendía las imágenes y al mismo tiempo respondía preguntas.

Se trata de un contexto multimodal y de formato largo en el backend de Gemini, que funciona sobre la marcha para identificar y entregar rápidamente una respuesta. En la demostración, sabía qué parte específica era el hablante e incluso podía identificar un distrito de Londres. También es productora porque rápidamente creó el nombre de una banda para un lindo cachorro junto a un animal de peluche (ver video arriba).

No se lanzará de inmediato, pero los desarrolladores y la prensa como nosotros en TechRadar lo probaremos en I/O 2024. Si bien Google no dio más detalles, hubo un adelanto de las gafas Astra, lo que podría significar que Google Glass puede ser haciendo una reaparición.

Sin embargo, incluso como demostración durante Google I/O, es muy impresionante y potencialmente muy convincente. Puede cargar nuestros teléfonos inteligentes y asistentes existentes de Google e incluso manzana. Además, también muestra las ambiciones reales de Google en el campo de la inteligencia artificial, una herramienta que puede resultar muy útil y que no requiere ningún uso rutinario.

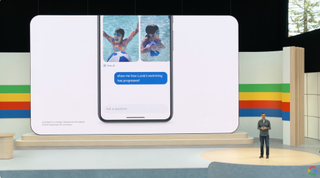

2. Google Photos recibe un útil impulso de IA de Gemini

¿Alguna vez has querido encontrar rápidamente una foto específica que tomaste en algún momento del pasado lejano? Tal vez sea una carta de un ser querido, una fotografía temprana de un perro cuando era cachorro o incluso su matrícula. Bueno, Google está haciendo realidad ese deseo con una importante actualización. imágenes de google Lo que lo combina con Géminis. Esto le da acceso a su biblioteca, le permite buscar en ella y le proporciona fácilmente el resultado que está buscando.

En una demostración en el escenario, Sundar Pichai reveló que puede solicitar su propia matrícula y la aplicación de fotografía le presentará una imagen que la muestra y los números/letras que componen su matrícula. Asimismo, puedes pedir fotografías de la época en que tu hijo aprendió a nadar, así como cualquier otro detalle. Debería facilitar la búsqueda incluso en bibliotecas de fotografías no organizadas.

Google ha llamado a esta función “Preguntar fotos” y la implementará para todos los usuarios en las “próximas semanas”. Es casi seguro que será útil y atraerá a personas que no lo utilizan. imágenes de google Un poco celoso.

3. La tarea de su hijo ahora es mucho más fácil gracias a NotebookLM

Todos los padres conocerán el horror de intentar ayudar a los niños con sus tareas; Si has sabido acerca de estas cosas en el pasado, no es posible que el conocimiento siga latente en tu mente 20 años después. Pero es posible que Google haya facilitado mucho la tarea gracias a una actualización de su aplicación para tomar notas NotebookLM.

NotebookLM ahora tiene acceso a Gemini 1.5 Pro y, según la demostración presentada en I/O 2024, ahora será un mejor maestro que nunca. La demostración mostró a Josh Woodward de Google cargando un cuaderno lleno de notas sobre un tema educativo, en este caso, la ciencia. Con solo presionar un botón, cree un tutorial detallado, con resultados adicionales que incluyen cuestionarios y preguntas frecuentes, todo tomado del material original.

Impresionante, pero estaba a punto de mejorar mucho. Una nueva característica, todavía un prototipo en este momento, fue capaz de generar todo el contenido como audio, creando esencialmente una discusión estilo podcast. Es más, el audio presenta a más de un orador, que habla sobre el tema de forma natural de una manera que sin duda sería más útil que un padre frustrado que intenta jugar al maestro.

Woodward incluso pudo interrumpir y hacer una pregunta, en este caso “Danos un ejemplo sobre baloncesto”, momento en el que la IA cambió de rumbo y ideó metáforas inteligentes para el tema, pero en un contexto accesible. Los padres del equipo de TechRadar están entusiasmados de probar esto.

4. Pronto podrás realizar búsquedas en Google mediante un vídeo.

En una extraña demostración en el escenario utilizando un tocadiscos, Google mostró un nuevo e impresionante truco de búsqueda. Ahora puedes grabar un vídeo, buscar los resultados y, con suerte, obtener una respuesta.

En este caso, era un empleado de Google que se preguntaba cómo utilizar el tocadiscos; Hice un registro fotografiando la unidad en cuestión mientras les preguntaba algo y luego se lo envié. Google ha hecho su magia de búsqueda y ha proporcionado una respuesta de texto que se puede leer en voz alta. Es una forma completamente nueva de investigar, como lente de google En el caso del vídeo, también es claramente diferente de la IA cotidiana del próximo proyecto de Astra, que debe grabarse y luego consultarse en lugar de trabajar en tiempo real.

Sin embargo, es parte de la tecnología y la IA generativa de Gemini combinadas con la Búsqueda de Google, con el objetivo de mantenerte en esa página y facilitar la obtención de respuestas. Antes de esta demostración de búsqueda en video, Google mostró una nueva experiencia generativa para recetas y comidas. Esto le permite buscar algo en lenguaje natural y obtener recetas o incluso recomendaciones de restaurantes en la página de resultados.

En pocas palabras, Google está apostando por la IA generativa en la búsqueda, tanto para los resultados como para las diferentes formas de obtenerlos.

Nos sorprendieron las creaciones. AbiertoAIHerramienta de conversión de texto a vídeo sora Durante los últimos meses, y ahora Google Únase a la video fiesta obstétrica con su nueva herramienta llamada Veo. Al igual que Sora, Veo puede crear videos de un minuto en calidad de 1080p, todo con un simple mensaje.

Este mensaje puede incluir efectos cinematográficos, como solicitar una toma temporal o una toma aérea, y Los primeros ejemplares parecen impresionantes. Tampoco tiene que empezar desde cero: cargue un vídeo con entrada de comando y Veo podrá editar el clip para que coincida con su pedido. También existe la opción de agregar máscaras y editar partes específicas del video.

¿Malas noticias? Al igual que Sora, Veo aún no está ampliamente disponible. Google dice que estará disponible para creadores seleccionados a través de VideoFX, una función de sus laboratorios beta, “en las próximas semanas”. Puede que pase algún tiempo hasta que veamos una implementación generalizada, pero Google ha prometido llevar esta función a todos. YouTube Cortos y otras aplicaciones. esto sera todo Adobe Se mueve incómodo en la silla creada por inteligencia artificial.

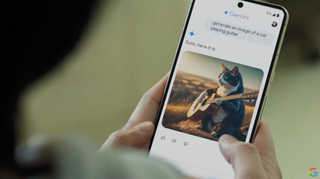

6. Android recibió un gran impulso de Gemini

Al igual que la función “Círculo para buscar” de Google se encuentra en la parte superior de la aplicación, Gemini ahora está integrado en el núcleo de Android para integrarse con su transmisión. Como se muestra, Gemini ahora puede ver, leer y comprender lo que hay en la pantalla de su teléfono, lo que le permite anticipar preguntas sobre lo que esté viendo.

De este modo, puede obtener el contexto del vídeo que estás viendo, anticipar una solicitud de resumen al ver un PDF largo o prepararte para hacer innumerables preguntas sobre la aplicación que estás usando. Tener IA consciente del contenido integrada en el sistema operativo de un teléfono no es tarea fácil. No es nada malo y puede resultar muy beneficioso.

Junto con la integración Gemini a nivel de sistema, Gemini Nano con multimodalidad se lanzará a finales de este año en dispositivos Pixel. ¿Qué le permitirá? Bueno, eso debería acelerar las cosas, pero la característica más destacada, por ahora, es escuchar llamadas y poder alertarte en tiempo real si se trata de spam. Esto es bastante bueno y se basa en la detección de llamadas, que es una característica de larga data en los teléfonos Pixel. Se espera que sea más rápido y se procese más en el dispositivo en lugar de enviarse a la nube.

7. Google Workspace se volverá más inteligente

Los usuarios del espacio de trabajo son Obtenga un tesoro de integraciones y funciones útiles de Gemini Puede tener un gran impacto en el día a día. Dentro de Mail, gracias al nuevo panel lateral de la izquierda, puedes pedirle a Gemini que resuma todas las conversaciones recientes con uno de tus colegas. Luego, el resultado se resume con puntos que destacan los aspectos más importantes.

Gemini en Google Meet puede brindarle los aspectos más destacados de la reunión o lo que otras personas en la llamada podrían preguntar. Ya no necesitarás tomar notas durante esa llamada, lo que puede resultar útil si es una llamada larga. Dentro de Google Sheets, Gemini puede ayudar a comprender los datos y procesar solicitudes, como retirar una cantidad o un conjunto de datos específicos.

El compañero de equipo virtual “Chip” podría ser el ejemplo más futurista. Puede estar presente en G-chat y ser llamado para diversas tareas o consultas. Aunque estas herramientas llegarán a Workspace, probablemente primero a través de funciones experimentales, la pregunta restante es cuándo llegarán a los clientes habituales de Gmail y Drive. Dado el enfoque de Google de llevar la IA a todos e impulsarla agresivamente a través de las búsquedas, probablemente sea sólo cuestión de tiempo.

También te puede interesar

[ad_2]

Source Article Link