[ad_1]

La desinformación en línea contribuyó a los disturbios en el Capitolio el 6 de enero de 2021.Crédito: Samuel Corum/Getty

“El Holocausto ocurrió. Las vacunas contra la COVID-19 han salvado la vida de millones de personas. No hubo un fraude generalizado en las elecciones presidenciales de Estados Unidos de 2020”. Intenso conflicto.

Aparecer En el artículo del comentario.1 Escrito por el científico cognitivo Ulrich Ecker de la Universidad de Australia Occidental en Perth y sus colegas, es uno de una serie de artículos en este número de la revista. naturaleza Dedicado a la desinformación en línea. Es un momento crucial para resaltar este tema. Ahora que más del 60% de la población mundial está conectada a Internet, la información falsa y engañosa se difunde más fácilmente que nunca, con consecuencias como una mayor renuencia a vacunarse.2 Y una mayor polarización política3. En un año en el que países con una población de alrededor de cuatro mil millones de personas celebran elecciones importantes, las sensibilidades en torno a la desinformación aumentan.

La desinformación representa una amenaza para la democracia mayor de lo que se podría pensar

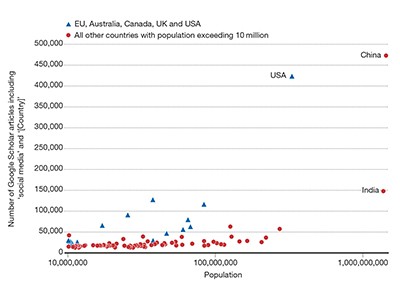

Sin embargo, existen percepciones comunes sobre la desinformación y lo que nos dicen investigaciones bien fundadas. No siempre estamos de acuerdoComo señalan Serene Budak de la Escuela de Información de la Universidad de Michigan en Ann Arbor y sus colegas en un artículo titulado “Perspectiva”.4. Existe una tendencia a sobreestimar la exposición de las personas, así como la influencia de los algoritmos en su determinación. Centrarse en las redes sociales a menudo significa ignorar tendencias sociales y tecnológicas más amplias que contribuyen a la difusión de información errónea.

El mensaje que envían los investigadores es que la desinformación se puede frenar. Pero para que eso suceda, las plataformas y los reguladores deben tomar medidas, proporcionando evidencia sobre cómo se difunde la información errónea y por qué debe recopilarse en comunidades diversas de todo el mundo.

Role Las plataformas de redes sociales contribuyen a difundir información errónea Aparece en un artículo de investigación.5 Por David Lazer, politólogo e informático de la Universidad Northeastern en Boston, Massachusetts, y sus colegas. Analizaron la actividad de más de 550.000 usuarios de Twitter durante el ciclo electoral presidencial de EE. UU. de 2020. Sus hallazgos son consistentes con la opinión de que la exposición pública a la desinformación está exagerada: solo el 7,5% de los usuarios compartieron una o más publicaciones de desinformación durante el período del estudio.

Este período incluyó el ataque al Capitolio de Estados Unidos el 6 de enero de 2021, tras el cual Twitter eliminó de la plataforma a 70.000 usuarios que se consideraba que estaban intercambiando información errónea. Los autores muestran que esta medida coincidió con una reducción significativa en el intercambio de información errónea. Es difícil saber si la prohibición modificó directamente el comportamiento de los usuarios o si la violencia en el Capitolio tuvo un efecto indirecto en la probabilidad de que los usuarios compartieran narrativas sobre las elecciones presidenciales “robadas” de 2020 que las impulsaron. De cualquier manera, escribe el equipo, las circunstancias constituyeron un experimento natural que demuestra cómo las plataformas de redes sociales pueden contrarrestar la información errónea imponiendo sus propios términos de uso.

Lea el artículo: Comprender mal los daños de la desinformación en línea

Actualmente parece poco probable que se repitan experiencias similares. Como dice el láser naturalezaÉl y sus colegas tuvieron la suerte de recopilar datos antes y durante el ataque, y de hacerlo en un momento en que Twitter era poco estricto en cuanto a los datos que permitía extraer a los científicos. Desde su adquisición por parte del empresario Elon Musk, la plataforma, ahora rebautizada como X, no sólo ha limitado la moderación y aplicación de contenidos, sino que también ha limitado el acceso de los investigadores a sus datos.

Existe una ambigüedad similar en otra parte, aún menos estudiada, del ecosistema de desinformación: su financiación. La desinformación no fue creada por Internet ni por las redes sociales, pero el modelo financiado con publicidad de la mayoría de los sitios web ha impulsado su producción. Por ejemplo, los intercambios de anuncios programáticos subastan espacios publicitarios a empresas en función de los sitios que navegan las personas, incluidos los sitios de desinformación, y los sitios obtienen una parte si los usuarios miran los anuncios y hacen clic en ellos.

En un segundo artículo de investigación6Wajeeha Ahmed, estudiante de doctorado de la Universidad de Stanford en California, y sus colegas demuestran que a las empresas también les va bien. Diez veces más probabilidades de ser anunciado en sitios de desinformación Si se anuncian mediante intercambios. Aunque las empresas pueden realizar un seguimiento de dónde colocan sus anuncios, la mayoría de los encargados de tomar decisiones en materia de publicidad subestiman su participación en la desinformación, y los consumidores tampoco lo saben.

¿La desinformación relacionada con la IA afectará las elecciones en la India?

Como dice Ahmed, la publicidad en línea “ocurre en la oscuridad”: al igual que ocurre con las redes sociales, la mayor parte de los datos necesarios para comprender cómo se difunde la información errónea se encuentran en las plataformas en línea. Si las plataformas están realizando sus propias intervenciones para tratar de limitar la difusión de información errónea, esto está sucediendo lejos del escrutinio público.

El primer paso para abordar la desinformación debería ser que las empresas interactúen más con los investigadores. Los estudios ya realizados muestran que es posible colaborar de forma ética sobre los datos garantizando al mismo tiempo la privacidad de las personas. Además, tomar medidas contra la difusión de falsedades comprobadas no equivale a limitar la libertad de expresión si se hace de forma transparente. Si las empresas no están dispuestas a compartir datos, los reguladores deberían obligarlas a hacerlo.

El surgimiento de aplicaciones de IA generativa, que reducen la barrera para producir contenido cuestionable, es otra razón para abordar este problema con urgencia. Como señalaron Kieran Garimella de la Universidad Rutgers en New Brunswick, Nueva Jersey, y Simone Chuchard de la Universidad Carlos III de Madrid, en un artículo de comentario7ellos Estudios sobre usuarios de la aplicación de mensajería WhatsApp en India Señala que el contenido de IA generativa no parece prevalecer todavía en la mezcla de desinformación, pero por lo que sabemos sobre cómo está evolucionando el uso de la tecnología, parece probable que sea solo una cuestión de tiempo.

El mundo tiene un interés común en reducir la difusión de información errónea y mantener el debate público centrado en cuestiones de evidencia y verdad. ¿Qué medidas de frenado funcionan y quién debería probarlas? En primer lugar, los investigadores independientes necesitan acceso a datos que permitan a la sociedad tomar decisiones informadas.

[ad_2]

Source Article Link