[ad_1]

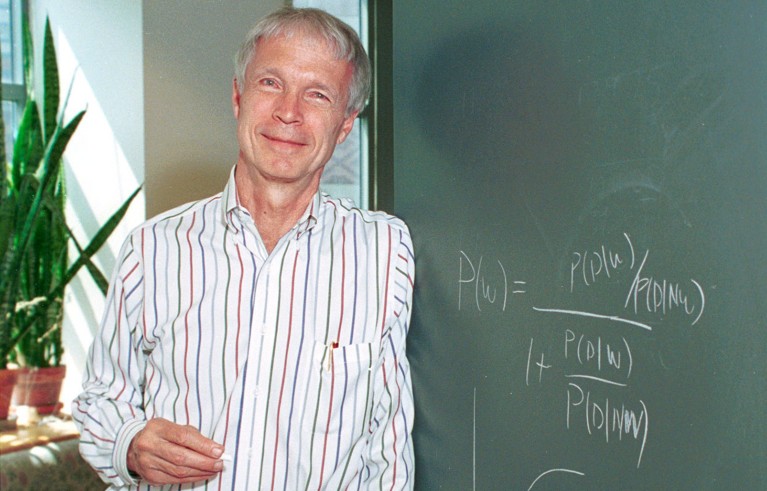

John Hopfield comenzó su carrera en física y pasó a estudiar problemas de química y biología.Crédito: Dennis Applewhite, Universidad de Princeton

John Hopfield, uno de los de este año Ganadores del Premio Nobel de FísicaEs un verdadero erudito. Comenzó su carrera estudiando física del estado sólido durante el apogeo de este campo en la década de 1950 antes de pasar a la química de la hemoglobina a finales de la década de 1960 y al estudio de la síntesis de ADN en la década siguiente.

Cómo ganar un Premio Nobel: ¿Qué tipo de científicos ganan medallas?

En 1982 creó una red similar al cerebro, en la que las neuronas, que modeló como moléculas que interactúan, formaban una especie de memoria. el “Red Hopfield”por el que recibió el Premio Nobel, hoy se considera ampliamente como un elemento fundamental Aprendizaje automáticoQue apoya la inteligencia artificial (IA) moderna. Hopfield compartió el premio con Geoffrey Hinton, pionero de la inteligencia artificial de la Universidad de Toronto en Canadá.

Hopfield, que ahora tiene 91 años y es profesor emérito de la Universidad de Princeton en Nueva Jersey, habló naturaleza Sobre si su trabajo es premiado Fue realmente física. Y por qué deberíamos preocuparnos por la inteligencia artificial.

Se ha debatido que su trabajo es premiado. No fue realmente físicaPero la informática. ¿Qué opinas?

Mi definición de física es que la física no es en qué se trabaja, sino cómo se trabaja en ello. Si tienes la posición de alguien que viene de la física, esto es un problema de física. Tener una madre y un padre físicos distorsionó mi visión de lo que es la física. Todo lo que te resultaba interesante en el mundo se debía a que entendías la física necesaria para montar algo así. Crecí con acertijos y quería resolverlos.

Los científicos esperan más que nunca por un Premio Nobel

En 1981, estaba dando una charla en una reunión y Terry Sinofsky, que era un estudiante de investigación en física, estaba sentado junto a Jeff Hinton. [Sejnowski now runs a computational neurobiology group at the Salk Institute in La Jolla, California.] Estaba claro que Jeff sabía cómo conseguir que un sistema de este tipo (cuya mecánica hago) expresara la informática. Finalmente hablaron y escribieron. Su primer artículo juntos. Terry lo recordó un día y era la historia de cómo las cosas pasaron de la física a la informática.

Empezaste tu carrera en física. ¿Cómo hiciste la transición a la biología?

La física del estado sólido fue la columna vertebral de las nuevas tecnologías de la época. Pero se volvió más difícil encontrar un buen problema, uno que pudiera resolver y que me interesara resolver. Y tenía un amigo, Bob Shulman, en los Laboratorios Bell, donde yo estaba en ese momento, que recientemente había pasado de la química a la biología, y empezó a hablar sobre el hecho de que se estaba empezando a poder estudiar moléculas biológicas en detalle. Tuve la idea de que tal vez era hora de utilizar la forma en que estudiamos el estado sólido en macromoléculas.

En su opinión, ¿qué ha aportado su enfoque de la física a la biología?

Lo que intenté hacer fue sintetizar la comprensión de sistemas más pequeños y luego tratar de ver si podía usar eso para comprender sistemas más grandes. ¿Quizás puedas pasar de la física, por un lado, a la biología, por el otro? Había problemas cuyos resultados podía imaginar, debido a mi comprensión abstracta del sistema físico al que estaba conectado.

El Premio Nobel de Física lo ganaron los pioneros del aprendizaje automático

A finales de la década de 1970, recurrió a la neurociencia y a los esfuerzos por simular el cerebro utilizando neuronas artificiales. ¿Cómo surgió la red Hopfield?

Comencé escribiendo ecuaciones simples que describían cómo la actividad del sistema nervioso cambia con el tiempo, debido a las interacciones del sistema consigo mismo y con el mundo exterior. Puedes pensar en el mismo tipo de ecuaciones para los sistemas de espín que interactúan en el magnetismo. Esto es lo que realmente me llevó a intentar conciliar ecuaciones de movimiento en un campo y en otro.

Hinton expresa abiertamente su preocupación por el daño potencial de la inteligencia artificial. ¿Te preocupas?

Estoy preocupado por eso. [Think about] La tecnología nuclear, que permite a la gente crear aleatoriamente grandes bombas, también podría ser muy útil. La gente empezó a preocuparse una vez que entendieron lo que era una reacción en cadena. En 1970, los biólogos estaban muy interesados en la ingeniería genética. Si diseñas un virus de la manera correcta, podrías estar cerca de eliminar a una población. Es básicamente una reacción en cadena. No me sorprendería que se pudiera introducir este tipo de riesgo en la IA, es decir, crear programas de tal manera que se autorreplicaran.

El premio de química es para los desarrolladores de AlphaFold AI, que predice estructuras de proteínas

El mundo no necesita una velocidad ilimitada en el desarrollo de la inteligencia artificial. Hasta que comprendamos más acerca de las limitaciones de los sistemas que se pueden crear (dónde se encuentra en esa escala de riesgo), estoy preocupado.

¿Qué consejo tienes para los estudiantes de doctorado de hoy?

Cuando dos campos estén separados entre sí, vea si hay algo interesante en la grieta entre ellos. Siempre me han parecido interesantes las interfaces porque contienen personas interesantes con diferentes motivaciones, y escucharlas discutir es muy esclarecedor. Te dice lo que realmente valoran y cómo intentan resolver el problema. Si no tienen las herramientas para solucionar el problema, puede haber un espacio para mí.

¿Sigues siendo un investigador activo?

No sé. Tengo un asistente, Dmitry Krotov. [at the MIT–IBM Watson AI Lab in Cambridge, Massachusetts]Que viene de la física teórica y disfruto hablar con él. No hago matemáticas estos días. Pero ciertamente disfruto interactuando con personas que intentan preguntar y responder problemas importantes. Es divertido recordar la variedad de problemas en los que trabaja la gente. Cuando enseñaba, siempre involucraba a gente joven, con diferentes puntos de vista, y así es como te mantienes joven.

Esta entrevista ha sido editada para mayor extensión y claridad.

[ad_2]

Source Article Link